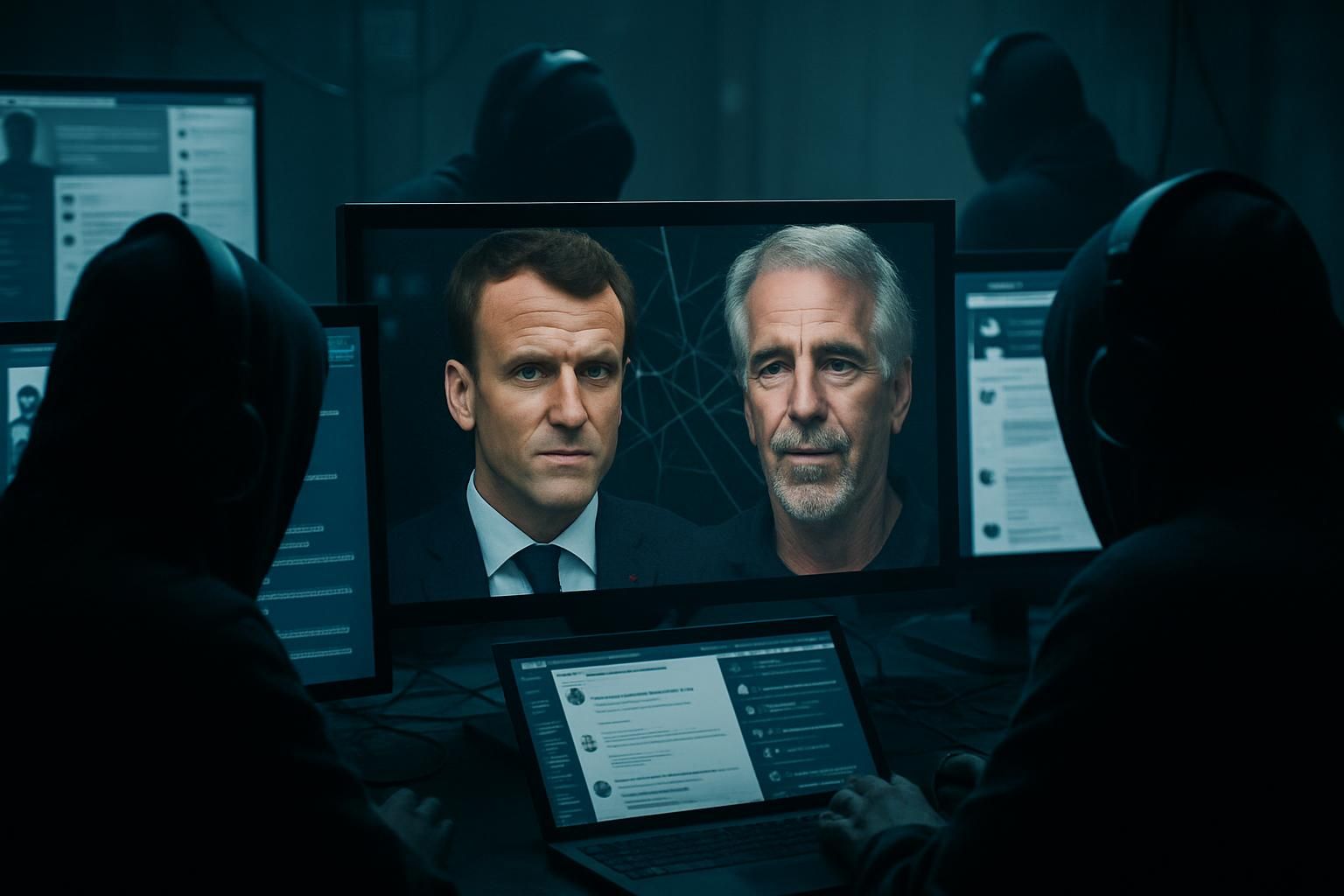

Polémique en ligne : les tentatives d’un réseau russe pour associer Emmanuel Macron à Jeffrey Epstein

En bref

- Une opération de désinformation identifiée comme émanant d’un réseau russe, Storm-1516, visait à associer Emmanuel Macron à Jeffrey Epstein.

- Elle reposait sur la création d’un site usurpant l’identité de France-Soir et sur la publication d’un article fantaisiste accusant le président d’implication dans l’affaire Epstein.

- L’amplification s’est principalement faite via X, avec l’utilisation supposée d’un réseau de relais et de contenus rémunérés ou coordonnés pour accroître la visibilité.

- Les autorités françaises, notamment Viginum, estiment que le mode opératoire informationnel CopyCop a été mobilisé pour structurer l’opération.

- La fausse information a été rapidement démentie par le média visé, qui a mis en garde contre l’usurpation, et les analyses soulignent que le vrai risque réside dans l’influence politique des fake news et la propagande ciblée sur les réseaux sociaux.

Polémique en ligne autour d’un montage visant Emmanuel Macron et Jeffrey Epstein illustre la manière dont les agents de la désinformation mobilisent des scénarios sensibles pour influencer l’opinion publique. Dans un contexte médiatique où les fake news circulent rapidement, les autorités françaises rappellent que les attaques informationnelles s’inscrivent dans un ensemble plus large de tentatives d’influence politique et de manipulation des perceptions. Le dispositif analysé s’appuie sur des éléments techniques précis : un site web factice, une équipe de relais sur les réseaux sociaux et une architecture informationnelle qui rappelle les procédures de CopyCop, un système connu pour ses mécanismes d’édition et de diffusion. Le phénomène n’est pas anodin et interpelle sur les moyens par lesquels les sociétés modernes gèrent l’épistémologie publique, c’est-à-dire la manière dont les informations sont vérifiées, interprétées et acceptées par le grand public.

Pour comprendre les mécanismes en jeu, il convient d’examiner les pièces du puzzle et les objectifs sous-jacents. Le site usurpé alimentait une narration prête à recouper des faits d’actualité et à les mêler à des personnalités publiques. Cette opération ne s’inscrivait pas dans un seul canal : elle a été conçue pour se diffuser rapidement sur les plateformes sociales et gagner en crédibilité par des relais d’influence. Dans ce cadre, les autorités ont systématiquement pointé du doigt le lien entre le mode opératoire et les techniques de propagande utilisées dans d’autres contextes géopolitiques. L’objectif est clair : susciter la confusion, brouiller les pistes et nourrir une suspicion générale à l’égard des institutions. L’histoire est emblématique d’un phénomène plus vaste où des acteurs externes tentent d’infiltrer le discours public en s’appuyant sur des sujets sensibles et polarisants.

La couverture médiatique et les récits qui en découlent peuvent être influencés par des facteurs humains et techniques. Parmi les éléments critiques, la crédibilité apparente du site, les signatures visuelles et les motifs de diffusion jouent un rôle déterminant dans la propagation du message. Les autorités insistent sur le fait que la visibilité n’est pas nécessairement synonyme d’impact réel : la perception peut être manipulée sans transformer durablement les opinions, surtout lorsque des efforts de décryptage et de contextualisation sont mis en œuvre par les organes d’information et les autorités compétentes. Ce qui compte, c’est la capacité des publics à distinguer le fait de l’opinion et à rester vigilants face à des contenus qui utilisent des noms connus pour légitimer des scénarios invraisemblables.

Pour aller plus loin dans la compréhension, plusieurs éléments factuels issus des rapports publics peuvent être consultés. Une analyse pointe le rôle de CopyCop, une infrastructure associée à un opérateur exilé et à des contenus qu’il gère à distance. Le déploiement initial a été repéré par Viginum, le service chargé de lutter contre les ingérences étrangères en ligne, qui a précisé que le site france-soir.net n’avait aucun lien avec France-Soir et que les mécanismes de CopyCop avaient été mobilisés pour structurer l’opération. Ces éléments confirment l’existence d’un schéma récurrent dans lequel des acteurs internationaux cherchent à manipuler des informations d’actualité pour créer des ponts entre individus publics et affaires sensibles. La vigilance restera primordiale dans les mois qui viennent, alors que les campagnes de désinformation évoluent rapidement et que les autorités affinent leurs outils de détection et de décryptage.

Pour situer ce type d’attaques dans un cadre plus large, il est utile de considérer les dynamiques de propagande qui se répètent à travers les années. Des mécanismes similaires ont été observés dans d’autres pays où des groupes malveillants tentent d’exploiter des sujets sensibles pour influencer des débats publics ou ternir l’image d’élites politiques. Les analyseurs et les journalistes s’accordent sur le fait que l’amélioration de la littératie médiatique et le renforcement des mécanismes de vérification restent des remèdes essentiels face à ces menaces. Cette affaire n’est pas seulement une histoire de manipulation technique : elle éclaire les fragilités d’un système informationnel et les responsabilités des acteurs publics et privés pour protéger l’intégrité du débat démocratique.

Exemple d’étude sur les dynamiques de polémique dans le domaine médiatique international montre que les mécanismes de propagation et de réinterprétation des faits sont transversaux, même dans des domaines qui paraissent éloignés de la politique. Un autre repère utile pour comprendre les effets des polémiques sur les trajectoires publiques est l’analyse des réactions des organes de contrôle face à des usages problématiques des plateformes sociales. Pour un complément d’information sur la manière dont des événements deviennent des polémiques globales, consulter une étude sur les dynamiques géopolitiques et leur influence médiatique.

Les mécanismes de diffusion et l’écosystème informationnel autour d’un montage politique

La diffusion rapide d’un montage politique passe par une chaîne à multiples maillons. Dans le cadre de cette affaire, l’élément déclencheur fut une page web qui usurpait l’identité d’un média respecté, alimentant une narration prête à être reprise par des comptes actifs et des relais. Le travail d’amplification s’est appuyé sur des stratégies bien connues dans le domaine de la propagande moderne : utilisation de comptes dont l’objectif est d’attirer l’attention, répétition de messages-clés et reproduction de formes narratives familières pour les publics susceptibles d’être sensibles à ce type de récits. Une fois le contenu initial publié, un ensemble de comptes sur les réseaux sociaux s’est chargé de la relance, ce qui a permis d’atteindre une audience large et diversifiée. L’analyse souligne que l’efficacité ne réside pas uniquement dans le nombre de partages, mais dans la manière dont un contenu est intégré dans des conversations quotidiennes et des sujets d’actualité qui structurent le discours public.

Au-delà des chiffres et des relais, l’étude met en évidence les techniques de manipulation psychologique employées. Le récit associe, de manière délibérée et répétée, le nom d’une personnalité publique à une affaire sensible, sans présenter de preuves vérifiables. Cette approche vise à créer une impression de conspiration ou de couverture médiatique qui mettrait en cause le leadership politique. Les mécanismes de crédibilité apparente — design du site, logos similaires, imitations d’articles — jouent un rôle central dans ce processus. Les chercheurs insistent sur le fait que la crédibilité initiale d’un contenu ne garantit pas son exactitude et que la vigilance cognitive des internautes est cruciale pour éviter de tomber dans les filets de ce type de manipulation.

Pour les professionnels du secteur, ce type d’opération fournit une matrice d’analyse enrichie par des cas concrets et documentés. Le réseau Storm-1516 est décrit comme un ensemble d’acteurs externes opérant dans l’ombre avec un mode opératoire récurrent : création d’un cadre pseudo médiatique, injection de contenus polarisants, amplification par des relais rémunérés et exploitation des actualités brûlantes pour gagner en résonance. Cette configuration rappelle les dynamiques observées dans d’autres épisodes internationaux où des groupes utilisent les périodes de fragilité informationnelle pour tester les capacités des systèmes de vérification et de réaction des institutions. Les spécialistes soulignent que l’un des défis majeurs réside dans la rapidité avec laquelle les contenus peuvent circuler et la difficulté à contenir leur propagation avant qu’ils ne laissent des traces durables dans le paysage médiatique.

Dans la même thématique

Réactions officielles et cadre de réponse face à la désinformation internationale

Face à ce type d’opération, les autorités françaises ont mis en place des mécanismes d’observation, de détection et de décryptage. Le service Viginum a identifié et analysé les procédés utilisés, et a précisé que l’usurpation était réalisée par des dispositifs informationnels connus comme CopyCop. Cette reconnaissance officielle souligne l’importance de disposer d’un cadre institutionnel capable de repérer rapidement les indices de manipulation et de les relier à des opérateurs transnationaux. L’action coordonnée entre les organes de presse, les plateformes et les services de sécurité permet de réagir rapidement : les médias concernés publient des démentis et dissocient formellement leur identité de celle des faux contenus, tandis que les opérateurs techniques procèdent à la traçabilité des contenus interdits ou trompeurs. La gravité des menaces est amplifiée lorsque les contenus trompeurs parviennent à être répliqués par des comptes qui semblent légitimes et qui interagissent avec des publics susceptibles d’être sensibles aux enjeux politiques.

Cette section met en évidence le rôle des acteurs institutionnels dans la protection du déchiffrement public. Les autorités rappellent que la lutte contre les ingérences étrangères en ligne repose sur la coopération entre les médias, les autorités et les utilisateurs eux-mêmes. L’information est fragile et sujette à interprétation, ce qui rend indispensable la vérification des sources et la mise à disposition d’outils d’analyse accessible au grand public. La détection précoce, associée à une réponse rapide et transparente, contribue à limiter l’impact des fausses informations et à préserver la confiance citoyenne dans les processus démocratiques. Le cas étudié illustre la nécessité d’un cadre normatif soutenu par des ressources techniques et humaines capables de contrecarrer les mécanismes d’influence étrangers et de renforcer la résilience du système médiatique.

Pour élargir la réflexion, on peut considérer des exemples voisins où les polémiques numériques ont suscité des débats similaires sur la vérification des faits et la responsabilité des plateformes. Des épisodes historiques de polémique et de mémoire collective offrent des cadres comparatifs utiles pour juger de l’évolution des mécanismes de gestion des contenus sensibles à l’ère numérique. À titre complémentaire, l’affaire liée à la couverture médiatique d’événements politiques permet d’observer comment les publiques réagir face à des montages et à des manipulations d’image dans des périodes électorales voire diplomatiques. Ce chapitre rappelle qu’en matière de désinformation, la transparence et la pédagogie restent des vecteurs essentiels pour maintenir la confiance citoyenne et prévenir les dérives propagandistes.

- Identifier promptement les signaux d’usurpation et vérifier l’identité du média impliqué.

- Analyser la chaîne de diffusion et les relais susceptibles d’être rémunérés ou formés pour amplifier.

- Mettre en place des dépôts de vérification et des démentis clairs en cas d’attaque informationnelle.

- Éduquer le public sur les mécanismes de manipulation et proposer des outils de vérification simples.

| Élément | Détails |

|---|---|

| Dépôt initial | Publication d’un article contrefait attribué à France-Soir sur une page web non officielle. |

| Mode opératoire | Utilisation d’un cadre informationnel CopyCop et de comptes relais sur X. |

| Couverture médiatique | Amplification par des relais supposément rémunérés, reproduction du contenu sur plusieurs comptes. |

| Réaction publique | Démenti du média visé et mise au point des autorités sur l’origine opérationnelle. |

La communauté médiatique reste vigilante face à ces mécanismes et s’interroge sur les pratiques à adopter pour limiter l’effet de contagion des manipulations. Le risque est de plus en plus élevé lorsque des contenus sensationnalistes et polarisants circulent rapidement et que les individus s’appuient sur des impressions initiales sans recouper les faits. La politique de transparence des médias et l’amélioration des outils de vérification seront des axes majeurs pour contrer ce type d’attaque dans les années à venir. À travers des analyses comparatives et des retours d’expériences, les professionnels du secteur renforcent les bonnes pratiques et diffusent des messages clairs sur la nature des informations fiables et vérifiables.

Pour ceux qui souhaitent approfondir l’étude, l’apport de la littérature spécialisée rappelle que la désinformation ne se limite pas à l’attaque d’un individu, mais vise à miner les institutions et à semer le doute sur le processus démocratique. Dans ce cadre, les journalistes et les chercheurs s’accordent à dire que la coopération entre les médias, les autorités et les plateformes est essentielle pour préserver l’intégrité du débat public et limiter les effets pervers des campagnes de propagande.

Deuxième vidéo à ce sujet et nouvelle perspective sur les mécanismes de désinformation et les réponses institutionnelles présentes sur les réseaux est disponible ci-dessous. Les experts insistent sur l’importance d’un filet de sécurité informatif qui peut aider les citoyens à mieux comprendre les enjeux et à prendre du recul face à des récits conjoncturels qui cherchent à polariser l’opinion.

Dans la même thématique

Leçons et recommandations pour renforcer la résilience informationnelle

Face à l’évolution rapide des techniques de désinformation, il est nécessaire d’adopter une approche holistique qui combine vigilance individuelle, responsabilité des plateformes et soutien institutionnel. Le premier axe consiste en une éducation médiatique proactive, qui enseigne comment vérifier les sources, repérer les signes de manipulation et distinguer les opinions des faits vérifiables. Cela passe par l’intégration de modules dédiés dans les programmes scolaires et par la diffusion d’outils simples pour le grand public, comme des guides de vérification et des check-lists avant de partager du contenu.

Le deuxième axe concerne les plateformes elles-mêmes. Il s’agit de développer des mécanismes transparents de traçabilité des contenus et d’améliorer les algorithmes de recommandation afin de limiter l’exposition à des contenus trompeurs, tout en protégeant la liberté d’expression. Les politiques publiques peuvent inciter les acteurs privés à adopter des standards plus stricts de vérification, sans entraver l’innovation. Enfin, les autorités doivent continuer à investir dans des équipes d’analyse et des outils technologiques pour détecter les réseaux d’influence et les structurer en réponses rapides et proportionnées.

Dans ce cadre, les citoyens sont aussi appelés à jouer un rôle actif. Il convient de privilégier les sources institutionnelles et les grands médias reconnus, tout en restant critiques face à l’abondance de contenus sensationnels. Cette posture demande du temps et de l’éducation continue, mais elle est essentielle pour préserver l’intégrité du débat public et éviter que des polémiques artificielles ne polarisent inutilement la société. L’objectif est clair : réduire la fragilité informationnelle et favoriser une culture de vérification, afin que les faits restent au centre des échanges publics et que la démocratie bénéficie d’un flux d’informations fiable et responsable.

Pour élargir la réflexion sur les mécanismes de manipulation et leur prévention, il peut être utile de consulter des ressources complémentaires sur des sujets similaires et des cas d’école. Le lien suivant propose une vue comparative sur les dynamiques de polémique dans le domaine public et sportif, illustrant comment les mêmes procédés se retrouvent dans des contextes variés et nécessitent des réponses adaptées: Cas de polémique et de gestion de l’image dans le sport.

Cette approche intégrée permet d’assurer une meilleure protection face aux tentatives de manipulation et de promouvoir une culture informationnelle plus robuste, où chaque citoyen peut agir comme vecteur de vérification et de vérité face à des récits polarisants et potentiellement nuisibles.

Qu’est-ce qui a été détecté précisément dans cette affaire de désinformation ?

Des autorités françaises ont identifié une opération visant à associer Emmanuel Macron à Jeffrey Epstein par le biais d’un site usurpant France-Soir et d’un article fictif, amplifié sur les réseaux sociaux, avec une architecture CopyCop et des relais sur X.

Qui est Storm-1516 et quel rôle joue CopyCop ?

Storm-1516 est décrit comme un réseau russe impliqué dans des campagnes d’influence en ligne; CopyCop est lié à une infrastructure qui soutient le mode opératoire informationnel et la collecte de contenus trompeurs.

Comment les autorités peuvent-elles réagir pour limiter l’impact ?

Le démenti rapide des médias ciblés, la traçabilité des contenus et l’amélioration des outils de vérification, soutenus par des campagnes d’éducation médiatique et des mesures des plateformes, constituent les axes essentiels de réponse.

Comment les citoyens peuvent-ils se protéger ?

En vérifiant les sources, en évitant de partager sans contexte et en s’appuyant sur les sources officielles et reconnues, tout en utilisant des guides de vérification et en signalant les contenus douteux aux plateformes concernées.

Source: www.ledauphine.com